大家好,今天小编关注到一个比较有意思的话题,就是关于lstm 训练要多久的问题,于是小编就整理了4个相关介绍的解答,让我们一起看看吧。

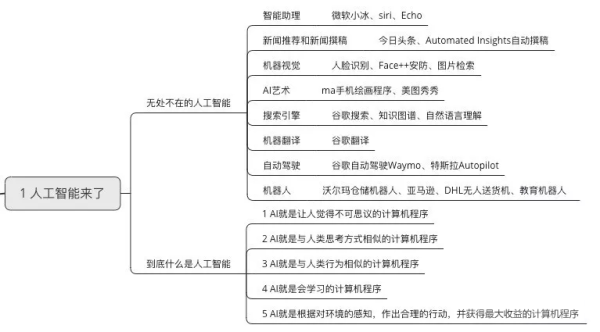

人工智能中最顶级尖端的研究?

人工智能中最顶级尖端的研究是太空电梯。

由于“太空电梯”项目对材料强度要求太高,以至于比目前人类制造出的最结实的钢材还要高出几百倍,所以Google短时间内还找不到可用的材料;其次,就算有一种碳纳米管可以达到他们的要求,但人类目前用这种材料制造出的线缆也不能超过一米。

lora训练用什么模型?

Lora训练使用的是长短期记忆网络(LSTM)模型。LSTM是一种递归神经网络,能够有效地处理序列数据,具有记忆和长期依赖性建模的能力。Lora利用LSTM模型来学习和预测时间序列数据,如语音识别、自然语言处理和股票预测等。通过LSTM模型的训练,Lora能够提高对序列数据的理解和预测能力,从而实现更准确的结果。

神经网络有哪几种?

1.前馈神经网络

这是一种最基本的神经网络类型,得益于技术的进步和发展,开发人员可以添加更多的隐藏层,而不必太担心其计算时间过长。而在深度学习技术的“教父”Geoff Hinton在1990年推出了反向传播算法之后,前馈神经网络开始得到广泛应用。

2.卷积神经网络(CNN)

在卷积神经网络(CNN)普及之前,人们***用很多算法对图像分类。人们过去常常根据图像创建特征,然后将这些特征输入到诸如支持向量机(SVM)之类的分类算法中。一些算法也将图像的像素水平值作为特征向量。例如,用户可以训练具有784个特征的支持向量机(SVM),其中每个特征都是28×28的图像像素值。

3.递归神经网络(LSTM/GRU /注意力)

卷积神经网络(CNN)主要针对图像的含义进行分类,递归神经网络(RNN)主要针对文本的含义分类。递归神经网络(RNN)可以帮助人们学习文本的顺序结构,其中每个单词都取决于前一个单词或前一个句子中的一个单词。

记忆门是什么意思?

是神经网络中的一种门控机制,旨在控制信息在神经元之间经过和遗忘的速度和强度。记忆门在循环神经网络(RNN)中得到了广泛的应用,它可以让模型学习长期依赖关系。记忆门机制通常与长短时记忆网络(LSTM)有关。

1 记忆门是指人类大脑中负责记忆的区域。

2 记忆门位于海马体和杏仁核附近,是大脑中负责短期记忆和长期记忆的重要区域。

在学习和记忆过程中,记忆门会将信息进行加工和编码,然后存储到大脑中的其他区域。

同时,记忆门也会对已经存储的信息进行检索和提取,以便人们能够回忆和使用这些信息。

3 如果想要提高记忆能力,可以通过以下步骤进行训练:

这个门(gate)是一种选择性的让信息通过的方式。它是由Sigmoid神经网络和矩阵逐点乘运算组成。 增加的三个神经网络层就代表LSTM的三个门(遗忘门、记忆门、输出门)。 遗忘门 顾名思义,要遗忘或丢弃一些信息。遗忘门的任务就是接受一个长期记忆

您好,记忆门是指神经元膜上的特定蛋白质通道,可以控制神经元内部的离子流动,从而影响神经元的兴奋性和记忆形成过程。在神经科学研究中,记忆门是一个重要的研究对象,因为它与记忆和学习密切相关。

到此,以上就是小编对于lstm训练过程的问题就介绍到这了,希望介绍的4点解答对大家有用。